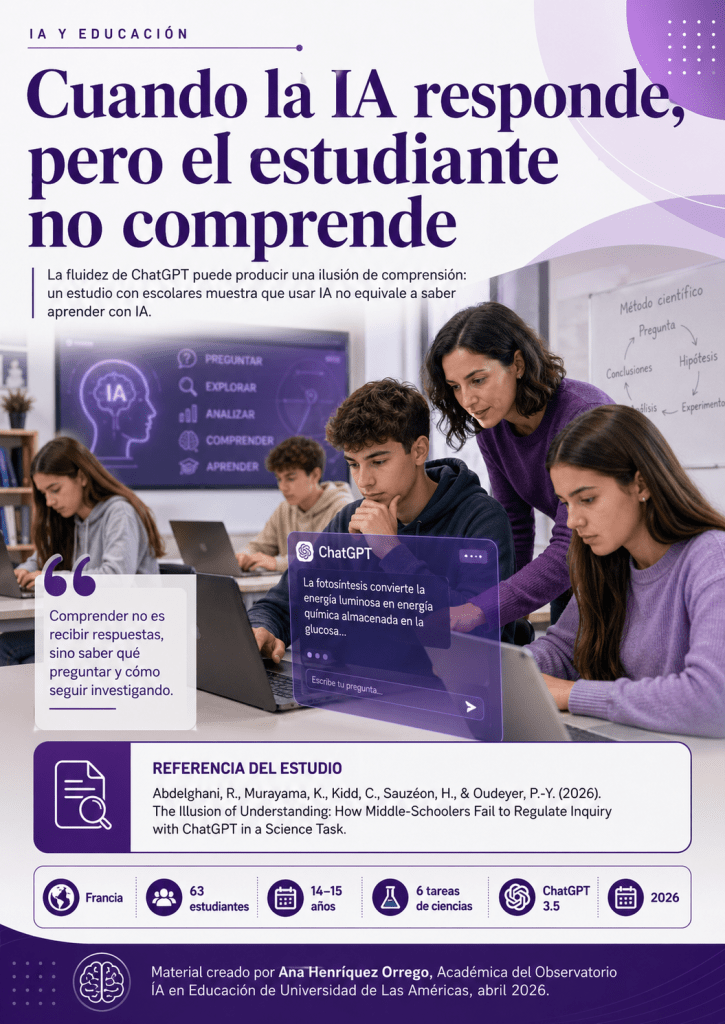

El artículo The Illusion of Understanding: How Middle-Schoolers Fail to Regulate Inquiry with ChatGPT in a Science Task (La ilusión de comprender: cómo estudiantes de secundaria no logran regular la indagación con ChatGPT en una tarea de ciencias), publicado en marzo de 2026 por Rania Abdelghani, Kou Murayama, Celeste Kidd, Hélène Sauzéon y Pierre-Yves Oudeyer, aborda una pregunta especialmente relevante para la educación actual: qué ocurre cuando estudiantes jóvenes usan ChatGPT para aprender, pero no cuentan todavía con suficientes herramientas metacognitivas para formular buenas preguntas, evaluar respuestas y sostener una indagación profunda.

El estudio se realizó con 63 estudiantes de 14 a 15 años en Francia, quienes desarrollaron seis tareas de investigación científica utilizando ChatGPT 3.5. Este dato es importante para contextualizar sus resultados: se trata de una investigación reciente, pero basada en una versión anterior de ChatGPT. Aun así, sus hallazgos siguen siendo altamente pertinentes, porque el problema que muestra no depende solo de la versión de la herramienta, sino de las capacidades que los estudiantes movilizan —o no movilizan— al interactuar con inteligencia artificial.

La tesis central del artículo es que la IA puede producir una “ilusión de comprensión”. Esto ocurre cuando el estudiante recibe una respuesta clara, fluida y aparentemente útil, pero no necesariamente logra comprender el concepto, verificar la calidad de la información ni identificar si necesita seguir preguntando. En otras palabras, la respuesta puede parecer suficiente antes de ser realmente formativa.

Los resultados son elocuentes. Muchos estudiantes no lograron distinguir con claridad entre preguntas eficientes e ineficientes; incluso utilizaron preguntas que ellos mismos habían evaluado como débiles. Además, aceptaron con frecuencia respuestas superficiales como si fueran útiles, hicieron pocas preguntas de seguimiento y cerraron tempranamente el proceso de indagación. El estudio muestra así que el acceso a ChatGPT no garantiza comprensión conceptual cuando falta regulación metacognitiva.

Una de las ideas más relevantes es que la confianza excesiva en la IA no necesariamente mejora el aprendizaje. Por el contrario, el artículo observa que una actitud demasiado positiva hacia la herramienta puede asociarse con menor capacidad para discriminar la calidad de las preguntas y de las respuestas. En cambio, la metacognición, la vigilancia epistémica y un escepticismo saludable aparecen como factores protectores para aprender mejor con IA.

La principal implicancia educativa es clara: alfabetizar en inteligencia artificial no puede reducirse a enseñar comandos, funciones o usos instrumentales. Formar estudiantes para aprender con IA exige enseñarles a preguntar mejor, evaluar la profundidad de las respuestas, pedir aclaraciones, contrastar información y elaborar conclusiones propias. La IA puede entregar respuestas; la comprensión sigue dependiendo de la actividad intelectual del estudiante.