Hoy tengo el agrado de dejar a su disposición una interesante y enriquecedora entrevista realizada a Erika Offerman y Carolina Olave, donde profundizamos en las posibilidades que la inteligencia artificial (IA) está abriendo en el ámbito del diseño instruccional. En este diálogo, abordamos especialmente las opciones que brindan los GPTs personalizados a los equipos responsables de crear y gestionar contenidos educativos.

Seguir leyendoTU ERES EL VISITANTE N°

- 8.738.741 Visitas

-

PUBLICACIONES RECIENTES

- OCDE 2026, perspectiva de educación digital. Explorando uso de la INTELIGENCIA ARTIFICIAL

- Desafíos en la Docencia Universitaria Actual

- Buenas prácticas docentes utilizando IA, ponencia en Universidad de Colima

- IA PARA POTENCIAR LA EXPERIENCIA DE APRENDIZAJE, Ponencia de Ana Henriquez Orrego en UCSC

- IA en Educación, Presentación de Ana Henriquez en Universidad de Valparaíso

- ¿Por qué ChatGPT no me pesca?, entrevista a Patricio Encina

- Evaluación auténtica resieliente a la Inteligencia Artificial

- Summit ÍA Viña del Mar

- Publicación digital: Entrevistas sobre usos de la IA en contextos laborales y educativos

- Video Aseguramiento de la Calidad Educativa en Tiempos de Inteligencia Artificial

- Impacto de la IA en la Calidad Educativa

- Claves para Evaluar Aprendizajes en Tiempos de Inteligencia Artificial

- Enseñar y aprender en tiempos de Inteligencia artificial, conferencia en CIINATIC 2025

- Dilemas éticos y uso responsable de la IA, Ponencia Ana Henriquez Orrego en Carabineros de Chile

- Aplicaciones de IA en Innovación Pedagógica

- Talleres sobre IA: Uso responsable y Creación de Asistentes Académicos (Noviembre 2025)

- Guerra Fría. Probando videos con nueva función de imagen en NotebookLM

- Diseño de asistentes viruales IA para la educación. Charla en Universidad San Ignacio de Loyola, Perú.

- ¿Cómo crear un asistente IA? Guía para crear GPTs personalizados.

- IA en educación primaria

- Inteligencia Artificial en la Educación Universitaria: Dilemas Éticos, Evaluación y Uso Responsable

- IA en EDUCACIÓN, Ana Henriquez Orrego

- NotebookLM 2025: cómo crear informes personalizados, cuestionarios y guías de estudio con inteligencia artificial

- Dilemas éticos y uso responsable de la IA, ponencia UNER

- IA en PERIODISMO

-

-

**LIBRO GUERRA FRÍA**

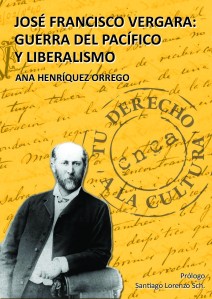

******LIBRO JFV******

-

Únete a otros 6.360 suscriptores

TODAS LAS PUBLICACIONES

Comentarios recientes

Páginas

- AUTOR

- BLOGS DE HISTORIA

- CALIDAD EN IES

- Creación de Asistentes Virtuales con IA: Curso Completo Gratis

- DIDÁCTICA HISTORIA Y GEO

- DOCUMENTOS HISTORIA CONTEMPORÁNEA

- ESQUEMAS MAPAS CONCEPTUALES

- FEDU UDLA

- ACTIVIDADES DE ACADÉMICOS DE FACULTAD DE EDUCACIÓN UDLA, 2019

- Conferencia Ernesto Treviño en inicio de año académico de FEDU UDLA, 2019

- Diplomado en Liderazgo de Establecimientos Educativos Inclusivos, AGOSTO 2019

- Escuela de Invierno 2019 en Sede Concepción

- Escuela de Invierno 2019 en Viña del Mar

- ESCUELA DE INVIERNO UDLA, 2019

- Escuela de Invierno UDLA, 2019 (La Tercera)

- Facultad de Educación organiza Escuela de Invierno 2019 con más de 300 participantes

- Formación Inicial Docente en UDLA

- Inicio de Año Académico FEDU, 2019

- Pedagogía en Inglés dio inicio a su cuarta versión del Taller de Inglés Avanzado para egresados y centro de práctica

- Ranking, acceso inclusivo

- Solicitudes externas

- GUERRA FRÍA

- Guía Práctica para Crear GPTs Personalizados. Diseño curricular.

- GUIAS-APRENDIZAJE HISTORIA UNIVERSAL

- ÍA EN EDUCACIÓN SUPERIOR

- Integrando ChatGPT en Enseñanza y Aprendizaje

- MAIS

- Modelo Educativo UDLA

- Modelos Educativos Universidades

- Perfil de Egreso – Calidad en Educación Superior

- PRESENTACIÓN HISTORIA1IMAGEN

- Probando GPTs

- Respaldo Curso IA para docentes

- Respaldos IA

- Sistemas Internos de Aseguramiento de la Calidad en Universidades

- Taller ChatGPT

- TALLERES IA

- Talleres IA GPTS